¡Hola! ¿Qué tal?

Esta es la primera edición de Marzo, la Edición #18 de The Work Survival Guide.

Y viene con un tema sensible que nos impacta a todos.

Español → 1ra parte | Inglés → 2da parte

Hello! How's it going?

This is the first issue of March, Issue #18 of The Work Survival Guide.

And it comes with a sensitive topic impacting all of us.

Spanish → 1st half

English → 2nd half

VERSIÓN EN ESPAÑOL

QUÉ ESPERAR DE LA EDICIÓN DE HOY:

SECCIÓN 1: 💭 LO QUE PIENSO DE... Tu Encuesta De Empleados Te Está Mintiendo

SECCIÓN 2: 📊 DATA VS DRAMA: Ponte En Las Pilas Y Haz El Trabajo Que Tienes Que Hacer

SECCIÓN 1️⃣ - MIS PERSPECTIVAS

💭 LO QUE PIENSO DE…

Tu Encuesta De Satisfacción Te Está Mintiendo

Qué Pasa Cuando Las Empresas Miden Mal, Calculan Mal, Y Descartan Lo Que No Les Gusta

La mayoría de las empresas tienen una encuesta de satisfacción de empleados.

Están orgullosos de ella. Hablan de cuánto les importa la retroalimentación. Cómo escuchan a su gente. Cómo quieren saber qué funciona y qué no.

Entonces llegan los resultados. Y los líderes lo celebran.

"¿Ves? Nuestra gente está feliz. La satisfacción mejoró. Lo estamos haciendo genial."

Excepto que no.

La encuesta estaba rota desde el principio. Una escala confusa. Una línea de tiempo que estaba mal. Un cálculo que hizo que las cosas se vieran mejor de lo que realmente son.

Y cuando alguien finalmente señala los problemas reales enterrados en los datos, el liderazgo no quiere escucharlo.

"Siempre se están quejando." "No entienden el contexto." "Esto realmente no es un problema."

Aquí está la verdad que nadie quiere admitir: la mayoría de las encuestas de empleados no están diseñadas para encontrar problemas. Están diseñadas para evitarlos.

● ● ●

Basura Entra, Basura Sale

Si tu encuesta está rota, tus datos son inútiles.

Pero la mayoría de las empresas no se dan cuenta de que su encuesta está rota porque están demasiado ocupadas celebrando los resultados.

Esto es lo que rompe las encuestas antes de que siquiera empiecen:

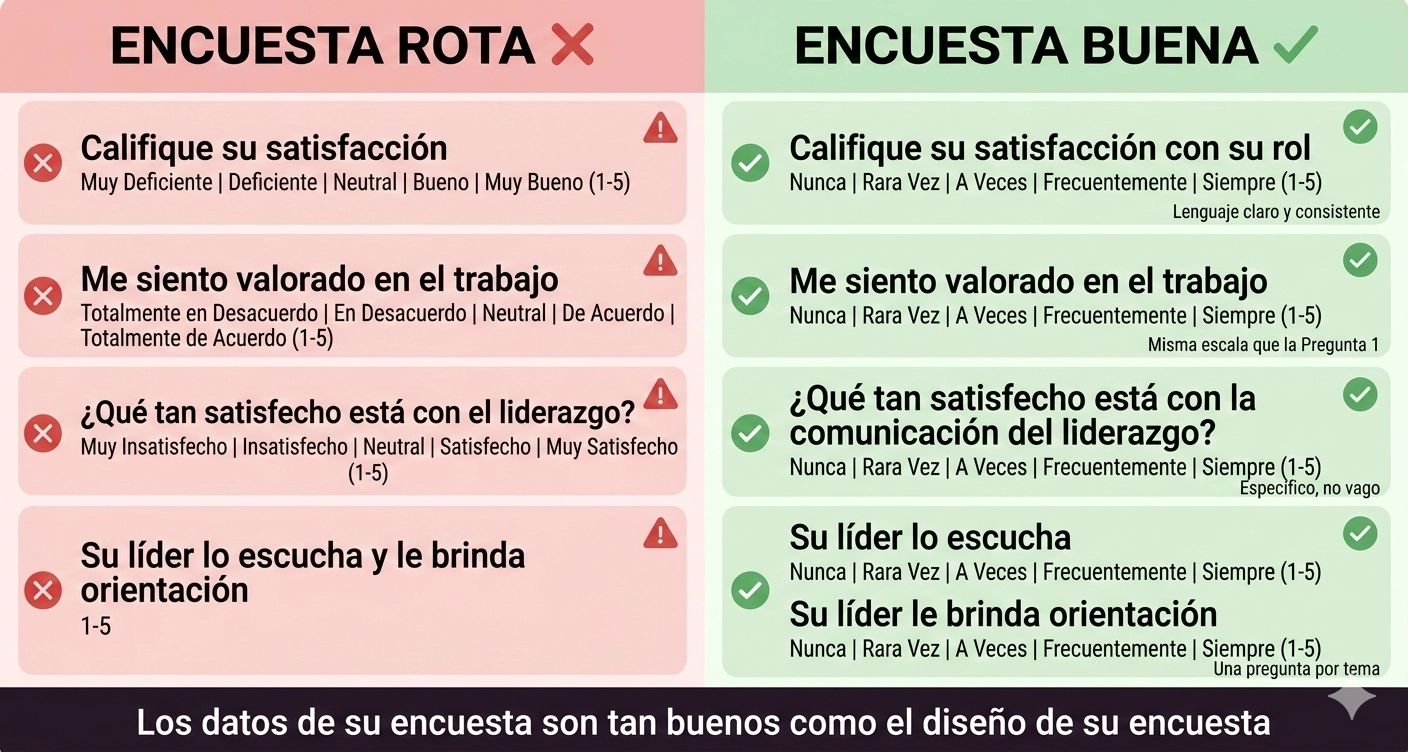

La escala es confusa y sigue cambiando

La pregunta 1 te pide que califiques de "Muy Pobre" a "Muy Bueno."

La pregunta 5 te pide que califiques de "Totalmente en Desacuerdo" a "Totalmente de Acuerdo."

La pregunta 8 te pide que califiques de "Muy Insatisfecho" a "Muy Satisfecho."

Misma encuesta. Tres escalas diferentes. Y nadie parece notarlo.

Entonces cuando ves una puntuación de 3 de 5, ¿qué significa eso? ¿Es neutral? ¿Es malo? ¿Es "estoy de acuerdo pero no estoy satisfecho?"

Nadie lo sabe. Ni siquiera las personas que la diseñaron.

Tus datos no son comparables. Es caos.

— — — — — — — — — —

Preguntas sobre dos cosas a la vez

"Tu líder te escucha y te da orientación."

Genial. ¿Qué pasa si mi líder escucha pero nunca da orientación? ¿Qué pasa si da orientación pero nunca escucha?

Lo califico con un 2. Pero no sabes qué parte es el problema. O si ambas lo son.

Solo sabes que algo está mal. Pero no puedes arreglar lo que no puedes identificar.

— — — — — — — — — —

La línea de tiempo es demasiado larga

Dejas la encuesta abierta durante tres meses.

Las personas que respondieron en enero están calificando una realidad diferente a las personas que respondieron en marzo. Tal vez el liderazgo cambió. Tal vez pasó una crisis. Tal vez la mitad del equipo renunció.

Promedias todo junto y lo llamas "sentimiento actual."

No es actual. Es un revoltijo de tres meses de sentimientos no relacionados.

— — — — — — — — — —

Las preguntas no están balanceada

7 preguntas sobre liderazgo. 1 pregunta sobre cultura. 1 pregunta sobre oportunidades de desarrollo. 2 preguntas sobre herramientas.

Entonces cuando calculas las puntuaciones por categoría, el liderazgo se ve terrible (porque preguntaste siete formas de decir lo mismo) y las herramientas se ven bien (porque apenas preguntaste).

Pero el problema real podrían ser las herramientas. Solo que no lo mediste apropiadamente.

O peor, estás preguntando lo mismo de siete formas diferentes, entonces la gente se frustra y empieza a hacer clic en respuestas al azar solo para terminar.

Tu encuesta no está midiendo satisfacción. Está creando desvinculación.

— — — — — — — — — —

Preguntaste demasiados detalles sobre ellos

No estás pidiendo su nombre o ID de empleado. Pero pides antigüedad, departamento, jefe, y puesto de trabajo.

En un equipo de 12 personas, si eres el único en tu departamento con 2 años de antigüedad reportando a ese jefe específico en ese rol?

Acabas de decirle a todos exactamente quién eres.

Esto no se siente anónimo. Esto no se siente seguro.

Entonces la gente o se salta la encuesta o miente en las preguntas demográficas o suaviza su retroalimentación real porque tienen miedo de ser identificados.

Tus datos acaban de volverse inútiles.

— — — — — — — — — —

● ● ●

Cuando Las Matemáticas Están Mal

Incluso si el diseño de tu encuesta es sólido, todavía puedes destruir los datos con malas matemáticas.

Esto es lo que las empresas hacen mal:

Promedian la escala equivocada

Usas una escala de 1-5. Pero calculas el promedio como si fuera lineal.

No lo es. La diferencia entre un 2 y un 3 no es la misma que la diferencia entre un 4 y un 5. Pero tu promedio los trata igual.

Entonces tu "puntuación promedio de 3.5" se ve bien. Pero está ocultando el hecho de que el 40% de tu gente te calificó con 1 o 2.

— — — — — — — — — —

Ignoran la distribución

Celebras un promedio de 4. Pero si la mitad de tu equipo dijo 5 y la mitad dijo 3, ese promedio no significa nada.

No es "la mayoría de la gente está satisfecha." Es "la mitad de tu equipo lo ama y la mitad de tu equipo está apenas conforme."

Eso no es insight. Eso es una crisis disfrazada de éxito.

— — — — — — — — — —

Comparan cosas incomparables

Corres una encuesta en enero. Luego otra en junio. Comparas las puntuaciones y dices "¡la satisfacción subió!"

Pero cambiaste las preguntas. Cambiaste la escala. Cambiaste a quién encuestaste.

No estás midiendo mejora. No estás midiendo nada.

— — — — — — — — — —

Segmentan la antigüedad demasiado ampliamente

"3 meses a 1 año" es una categoría. "1 a 3 años" es otra. "Más de 5 años" es la última.

Acabas de juntar a alguien que lleva 4 meses con alguien que lleva 11 meses. Esa no es la misma experiencia. Esa no es la misma perspectiva.

¿Y peor? Excluiste a todos los que tienen menos de 3 meses.

¿Por qué? ¿Porque no quieres escuchar cómo es realmente tu onboarding? ¿Porque los nuevos empleados "no saben lo suficiente aún" para tener opiniones válidas?

Ellos acaban de experimentar tu proceso de contratación, tu onboarding, tus primeras impresiones. Tienen la visión más fresca y sin filtros de cómo es realmente unirse a tu empresa.

Y los filtraste.

— — — — — — — — — —

Miran las puntuaciones e ignoran los comentarios. O lo opuesto

El liderazgo celebra un promedio de 4.2 y nunca lee los comentarios.

O se obsesionan con un comentario brutal e ignoran 50 puntuaciones positivas.

Ambos están rotos.

A veces la gente te da una puntuación alta pero te revientan en los comentarios. A veces te dan una puntuación baja y dejan los comentarios en blanco.

Ambos dicen algo. Necesitas leer ambos. Juntos. No por separado.

Si solo estás mirando números, te estás perdiendo la historia. Si solo estás leyendo comentarios, te estás perdiendo el patrón.

— — — — — — — — — —

● ● ●

El Miedo A Las Malas Noticias

Aquí está el problema real: la mayoría de las empresas no quieren la verdad.

Quieren tranquilidad.

Quieren escuchar que la gente está feliz. Que el liderazgo está haciendo un buen trabajo. Que no es necesario cambiar nada importante.

Entonces cuando los resultados de la encuesta regresan y muestran problemas reales, entran en pánico.

HR se asusta

Porque si los datos muestran que el liderazgo es el problema, HR tiene que decirle al liderazgo. Y esa es una conversación peligrosa.

Entonces lo suavizan. Lo replantean. Entierran las malas noticias en un mar de "oportunidades de crecimiento."

Los datos dijeron "tus managers son terribles." El reporte dice "hay espacio para mejorar la efectividad del liderazgo."

El liderazgo se pone a la defensiva

Porque nadie quiere escuchar que su gente está infeliz. Especialmente si han estado trabajando duro para crear una "cultura genial."

Entonces lo descartan.

"Solo se están quejando." "No ven el panorama completo." "Toda empresa tiene algunos empleados descontentos."

Los datos se convierten en el enemigo. Y las personas que los sacaron a la luz se convierten en el problema.

● ● ●

Escucha Selectiva

Incluso cuando el liderazgo dice que quiere retroalimentación honesta, solo escuchan la retroalimentación que les gusta.

¿Buenas puntuaciones? Esa es prueba de que lo estamos haciendo genial.

¿Malas puntuaciones? Esa es gente que no entendió la pregunta.

¿Comentarios positivos? Compártelos en el all-hands.

¿Comentarios negativos? "Oh, eso es solo una persona. No es representativo."

Así es como suena eso en la vida real:

Los datos muestran que la gente odia el nuevo proceso. Liderazgo: "Solo necesitan más entrenamiento. Verán el valor eventualmente."

Los datos muestran que la gente no confía en sus managers. Liderazgo: "No hay entrenamiento de desarrollo para líderes. Necesitamos un mejor programa de liderazgo."

Los datos muestran que la gente se siente sobrecargada y quemada. Liderazgo: "Esa es solo la naturaleza de nuestra industria. Todos se sienten así."

No. No todos se sienten así. TU gente se siente así. Y descartarlo no hace que desaparezca.

● ● ●

Métricas De Vanidad vs. Realidad

La mayoría de las encuestas de empleados miden las cosas equivocadas.

Miden lo que hace que el liderazgo se sienta bien. No lo que realmente importa.

Métrica de vanidad:

"Puntuación general de satisfacción"

Esto no te dice nada. La gente puede estar "satisfecha" y todavía estar buscando otros trabajos.

Satisfecho no significa comprometido. No significa leal. No significa productivo.

Significa "No lo odio lo suficiente como para quejarme en una encuesta.”

➡️

Métrica de realidad:

"¿Recomendarías esta empresa a un amigo?

Esto te dice todo.

Porque la gente no recomienda lugares con los que solo están "satisfechos."

Recomiendan lugares en los que realmente creen."

Métrica de vanidad:

"¿Cómo te sientes sobre los valores de nuestra empresa?"

A nadie le importan tus valores.

Les importa si realmente los vives.

Preguntar cómo se siente la gente sobre tus valores es inútil.

Pregunta si el liderazgo los demuestra. Pregunta si las decisiones se alinean con ellos.

Esos son los datos que importan.

➡️

Métrica de realidad:

"¿Te ves un futuro aquí? o ¿Cuánto tiempo planeas seguir trabajando aquí?"

Esta es la pregunta de retención.

Si la gente no puede ver un futuro, ya están a mitad de camino de la puerta.

Y ninguna cantidad de puntuaciones "satisfechas" los mantendrá.

● ● ●

El Costo De La Negación

Cuando las empresas miden mal, calculan mal, y descartan lo que no les gusta, esto es lo que pasa:

La gente buena se va

Porque te dijeron lo que estaba mal. Y lo ignoraste. Entonces dejan de decirte. Y empiezan a buscar en otro lado.

Los problemas empeoran

Porque no los estás arreglando. Estás pretendiendo que no son lo suficientemente relevantes. Y pretender no los hace más pequeños. Los hace más grandes.

Pierdes credibilidad

Porque todos saben que los resultados de la encuesta son basura. Conocen los problemas reales. Los viven todos los días.

Entonces cuando el liderazgo se para y dice "la encuesta muestra que lo estamos haciendo genial," nadie lo cree.

¿La próxima vez que preguntes? No se molestarán. O peor, te dirán lo que quieres escuchar solo para terminarlo.

Y entonces empieza la caza de brujas

Los líderes de alto nivel ven malos resultados e inmediatamente buscan a alguien a quien culpar.

Es culpa de los managers. Despídelos. Reemplázalos. Arregla las puntuaciones.

De repente, los managers de nivel medio y de primera línea están aterrados. No de la encuesta. De lo que pasa después.

Porque saben: malos resultados significan que alguien será culpado. Y probablemente son ellos.

Entonces empiezan a manejar la encuesta en lugar de manejar a sus equipos. Insinúan lo que la gente debería decir.

Explican por qué ciertas puntuaciones "no serían justas."

Crean un ambiente donde la gente se siente presionada a calificar las cosas más alto de lo que realmente son.

Y ahora tu encuesta no está midiendo realidad. Está midiendo miedo.

El problema no son los managers. El problema es el sistema. Y lo acabas de empeorar castigando a las personas que estaban intentando decirte.

● ● ●

Cómo Saber Si Tu Encuesta Está Realmente Funcionando

No necesitas ser un científico de datos. Solo necesitas hacer mejores preguntas.

¿La encuesta está diseñada para encontrar problemas o evitarlos? - Si cada pregunta está planteada positivamente, estás buscando cumplidos.

¿Estás midiendo lo que importa o lo que es fácil? - La satisfacción es fácil. La intención de retención es difícil. Las preguntas difíciles te dan datos reales.

¿Estás dispuesto a actuar sobre las malas noticias? - Si la respuesta es no, no corras la encuesta. Estás perdiendo el tiempo de todos.

¿La gente confía en que su retroalimentación es anónima? - Si no confían, no serán honestos. Y tus datos no valen nada.

¿Puedes explicar los resultados sin darle vueltas? - Si necesitas "replantear" los datos para que suenen bien, los datos no son buenos.

● ● ●

Cómo Se Ve Lo Bueno (Lo Básico)

No necesitas una encuesta perfecta. Necesitas una que no te esté mintiendo activamente.

Diseñala bien📋

Usa una escala clara y consistente. Define qué significa cada número.

Pregunta una cosa por pregunta. No preguntas compuestas.

Mantenla bajo 20 preguntas. Respeta el tiempo de la gente.

Córrela durante un período corto y consistente. Dos semanas máximo, no tres meses.

Pregunta solo demografía esencial. Mientras menos, más segura se siente la gente.

Calcúlala bien🧮

Mira la distribución, no solo los promedios.

Segmenta la antigüedad en incrementos significativos (0-3 meses, 3-6 meses, 6-12 meses, 1-2 años, 2-5 años, 5+ años).

No excluyas a los nuevos empleados. Su retroalimentación importa.

Segmenta los datos. No juntes a todos.

Lee puntuaciones Y comentarios. Juntos. No por separado.

Compara manzanas con manzanas. Mismas preguntas, misma escala, misma audiencia.

Presenta honestamente 📊

Lidera con las malas noticias. No las entierres.

Muestra el panorama completo. No solo lo destacado.

Reconoce lo que está roto. No le des vueltas.

Actúa sobre ella: ☑️

Escoge 2-3 problemas reales. Arréglalos.

Comunica lo que estás haciendo. Y por qué.

Haz seguimiento. Muestra a tu gente que su retroalimentación importó.

Eso es todo. No necesitas herramientas sofisticadas. Necesitas honestidad.

● ● ●

Cómo Separar Problemas Reales Del Ruido

No toda queja es una crisis. Pero tampoco toda queja es ruido.

Aquí está la prueba:

¿Es específico? - "La moral está baja" es vago. "La gente no se siente escuchada en las reuniones" es específico. Los problemas específicos son problemas reales.

¿Es recurrente? - Una persona quejándose del parqueo no es una tendencia. Diez personas quejándose del mismo manager sí lo es.

¿Impacta el trabajo? - "El café es malo" es molesto. "No tenemos las herramientas para hacer nuestro trabajo" es una crisis.

¿Puedes arreglarlo? - Si sí, arréglalo. Si no, reconócelo y explica por qué. No lo ignores solo porque es difícil.

● ● ●

La Dura Verdad

Tu encuesta de empleados no te está mintiendo a propósito.

Te estás mintiendo a ti mismo.

Diseñaste una encuesta que te hace sentir bien. Calculaste los resultados para que se vieran mejor de lo que son. Descartaste la retroalimentación que no querías escuchar.

Y ahora estás sorprendido de que la gente no confíe en ti.

Esto es lo que realmente importa:

Tu gente sabe lo que está roto. Lo viven todos los días.

Si no estás dispuesto a escucharlo, no preguntes.

Pero si preguntas, y te dicen, y lo ignoras?

No te sorprendas cuando dejen de responder tus encuestas.

Y no te sorprendas cuando dejen de trabajar para ti.

SECCIÓN 2️⃣ - DATA VS. DRAMA

📊 PONTE EN LAS PILAS Y HAZ EL TRABAJO QUE TIENES QUE HACER

Recibiste malos resultados en la encuesta.

Duele. Se siente personal. Estás enojado. Estás a la defensiva. Quieres saber quién dijo qué. Quieres explicar por qué están equivocados.

Eso es drama.

Aquí está la data: tu gente te dijo lo que está roto. Ahora lo arreglas.

Pero primero, tienes que procesarlo sin perder la cabeza.

Paso 1️⃣: Siéntelo, luego ciérralo | Paso 2️⃣: Separa los problemas de la empresa de los problemas de liderazgo |

|---|---|

Lee los resultados. Lee los comentarios. Siente lo que vas a sentir - enojo, dolor, defensividad, shock. Entonces ciérralo. Aléjate. Déjalo respirar. Espera 2-3 días. Luego ábrelo de nuevo. Te prometo que no dolerá tanto la segunda vez. Si todavía duele, repite. A la tercera va la vencida. No lo estás evitando. Te estás dando espacio para moverte del drama a los datos. | Revisa los resultados y divídelos en dos listas: - Problemas sobre la empresa (herramientas, políticas, recursos, estructura) - Problemas sobre tu liderazgo directamente (comunicación, confianza, apoyo, decisiones) Esto te da perspectiva. Algunas cosas las puedes arreglar. Otras no. Pero necesitas saber cuál es cuál. |

Paso 3️⃣: NO intentes averiguar quién dijo qué | Paso 4️⃣: Pide más retroalimentación |

|---|---|

Sé que quieres. No lo hagas. Es inútil. Es una traición de confianza. Y honestamente? La mayoría de esto no debería ser una sorpresa. Si ES una sorpresa, ese es el problema real. Significa que tu gente no se ha sentido lo suficientemente segura como para decirte esto antes. Ese es tu trabajo. No una cacería de brujas. | Ya tienes una lista de problemas. Ahora ve a tu equipo y haz preguntas aclaratorias. "La encuesta mostró preocupaciones sobre X, Y, y Z. ¿Cuál de estos se siente más urgente para ustedes? ¿Qué ayudaría realmente?" Te dirán qué es lo que más importa. Te darán soluciones. No tienes que descubrirlo solo. Trabaja en una matriz de prioridades con tu equipo. Deja que te digan por dónde empezar. |

Paso 5️⃣: Construye tu plan de acción y empieza a trabajar |

|---|

NO esperes a que HR te diga qué hacer. NO esperes a que alguien más lo arregle por ti. Escoge 2-3 cosas que realmente puedas mejorar. Haz un plan. Comunícalo. Empieza. Luego haz seguimiento. Muestra a tu gente que su retroalimentación importó. Así es como te mueves del drama a los datos. |

● ● ●

Si ves problemas en el diseño de la encuesta (escalas rotas, preguntas confusas, demasiada demografía), habla con HR.

Plantéalo como una oportunidad de análisis de datos. No como un ataque.

"Oye, noté que la encuesta mezcla escalas y hace preguntas compuestas. Eso está haciendo difícil actuar sobre la retroalimentación. ¿Podemos limpiar esto para la próxima vez?"

No estás culpando a HR. Estás mejorando la herramienta para que todos tengan mejores datos.

● ● ●

La diferencia entre drama y data:

Drama = "¿Quién dijo esto? ¿Por qué son tan malagradecidos? Trabajo tan duro por ellos."

Data = "Okay, esto es lo que está roto. Esto es lo que puedo arreglar. Aquí es donde empiezo."

Uno te mantiene atascado. El otro te mueve hacia adelante.

Elige data.

¡Nos vemos la próxima semana!

Mariné Rivera P.

ConsultivEX Solutions | www.consultivexs.com

Tienes retroalimentación ó ideas. Escríbenos. Leemos todo. O responde la encuesta.

NUESTRAS PAUTAS

🔥 Nuestras historias vienen de nuestros lectores, nosotros solo escogemos las mejores.

✍️ Escrito por personas reales, para personas reales. Siempre.

📰 No hablamos de política, religión, ni de ningún tema que pueda causar que alguien se ofenda. No es lo nuestro.

🚀 La IA nos ayuda, pero no nos guía.

🌐 Siempre compartimos nuestras fuentes para poder copiar descaradamente las mejores prácticas.

🎯 No forzamos contenido. Si no hay nada valioso y que valga la pena compartir en una sección, chao la sección esa semana.

ENGLISH VERSION

WHAT TO EXPECT FROM TODAY’S ISSUE:

SECTION 1: 💭 MY THOUGHTS ON... Your Employee Survey Is Lying To You

SECTION 2: 📊 DATA VS DRAMA: Get Your Shit Together And Do The Work You Need To Do

SECTION 1️⃣ - MY INSIGHTS

💭 MY THOUGHTS ON…

Your Employee Survey Is Lying To You

What Happens When Companies Measure Wrong, Calculate Wrong, And Dismiss What They Don't Like

Most companies have an employee satisfaction survey in place.

They're proud of it. They talk about how much they care about feedback. How they listen to their people. How they want to know what's working and what's not.

Then the results come in. And leadership celebrates.

"See? Our people are happy. Engagement is up. We're doing great."

Except they're not.

The survey was broken from the start. A confusing scale. A timeline that was wrong. A calculation made things look better than they actually are.

And when someone finally points out the real problems buried in the data, leadership doesn't want to hear it.

"Oh, they're always complaining." "They don't understand the context." "This isn't really a problem."

Here's the truth nobody wants to admit: most employee surveys aren't designed to find problems. They're designed to avoid them.

● ● ●

Garbage In, Garbage Out

If your survey is broken, your data is useless.

But most companies don't realize their survey is broken because they're too busy celebrating the results.

Here's what breaks surveys before they even start:

The scale is confusing and keeps changing

Question 1 asks you to rate from "Very Poor" to "Very Good."

Question 5 asks you to rate from "Strongly Disagree" to "Strongly Agree."

Question 8 asks you to rate from "Very Dissatisfied" to "Very Satisfied."

Same survey. Three different scales. And nobody seems to notice.

So when you see a score of 3 out of 5, what does that mean? Is that neutral? Is that bad? Is that "I agree but I'm not satisfied?"

Nobody knows. Not even the people who designed it.

Your data isn't comparable. It's chaos.

— — — — — — — — — —

The questions ask two things at once

"Your leader listens to you and provides guidance."

Great. What if my leader listens but never gives guidance? What if they give guidance but never listen?

I rate it a 2. But you don't know which part is the problem. Or if both are.

You just know something's wrong. But you can't fix what you can't identify.

— — — — — — — — — —

The timeline is too long

You leave the survey open for three months.

People who responded in January are rating a different reality than people who responded in March. Maybe leadership changed. Maybe a crisis happened. Maybe half the team quit.

You average it all together and call it "current sentiment."

It's not current. It's a three-month smoothie of unrelated feelings.

— — — — — — — — — —

The questions aren't balanced

Seven questions about leadership. One question about culture. One question about development opportunities. Two questions about tools.

So when you calculate category scores, leadership looks terrible (because you asked seven ways to say the same thing) and tools look fine (because you barely asked).

But the real problem might be tools. You just didn't measure it properly.

Or worse, you're asking the same thing seven different ways, so people get frustrated and start randomly clicking answers just to finish.

Your survey isn't measuring engagement. It's creating disengagement.

— — — — — — — — — —

You asked too many details about them

You're not asking for their name or employee ID. But you ask for tenure, department, manager, and job position.

In a team of 12 people, if you're the only one in your department with 2 years of tenure reporting to that specific manager in that role?

You just told everyone exactly who you are.

This doesn't feel anonymous. This doesn't feel safe.

So people either skip the survey or lie on the demographic questions or soften their real feedback because they're afraid of being identified.

Your data just became worthless.

— — — — — — — — — —

● ● ●

When The Math Is Wrong

Even if your survey design is solid, you can still destroy the data with bad math.

Here's what companies get wrong:

They average the wrong scale

You use a 1-5 scale. But you calculate the average as if it's linear.

It's not. The difference between a 2 and a 3 isn't the same as the difference between a 4 and a 5. But your average treats them the same.

So your "average score of 3.5" looks okay. But it's hiding the fact that 40% of your people rated you a 1 or 2.

— — — — — — — — — —

They ignore the distribution

You celebrate an average of 4. But if half your team said 5 and half said 3, that average is meaningless.

It's not "most people are satisfied." It's "half your team loves it and half your team is just okay with it.”

That's not insight. That's a crisis dressed up as a success.

— — — — — — — — — —

They compare incomparable things

You run a survey in January. Then another in June. You compare the scores and say "engagement is up!"

But you changed the questions. You changed the scale. You changed who you surveyed.

You're not measuring improvement. You're measuring nothing.

— — — — — — — — — —

They segment tenure too broadly

"3 months to 1 year" is one category. "1 to 3 years" is another. "More than 5 years" is the last one.

You just lumped someone who's been here 4 months with someone who's been here 11 months. That's not the same experience. That's not the same perspective.

And worse? You excluded everyone under 3 months.

Why? Because you don't want to hear what your onboarding is really like? Because new hires "don't know enough yet" to have valid opinions?

They just experienced your hiring process, your onboarding, your first impressions. They have the freshest, most unfiltered view of what it's actually like to join your company.

And you filtered them out.

— — — — — — — — — —

They look at scores and ignore comments. Or the opposite

Leadership celebrates a 4.2 average and never reads the comments

Or they obsess over one brutal comment and ignore 50 positive scores.

Both are broken.

Sometimes people give you a high score but hammer you in the comments. Sometimes they give you a low score and leave the comments blank.

Both say something. You need to read both. Together. Not separately.

If you're only looking at numbers, you're missing the story. If you're only reading comments, you're missing the pattern.

— — — — — — — — — —

● ● ●

The Fear Of Bad News

Here's the real problem: most companies don't want the truth.

They want reassurance.

They want to hear that people are happy. That leadership is doing a good job. That nothing major needs to change.

So when the survey results come back and show real problems, they panic.

HR gets scared.

Because if the data shows leadership is the problem, HR has to tell leadership. And that's a dangerous conversation.

So they soften it. They reframe it. They bury the bad news in a sea of "opportunities for growth."

The data said "your managers are terrible." The report says "there's room to enhance leadership effectiveness."

Leadership gets defensive.

Because nobody wants to hear that their people are unhappy. Especially if they've been working hard to create a "great culture."

So they dismiss it.

"They're just complaining." "They don't see the big picture." "Every company has a few disgruntled employees."

The data becomes the enemy. And the people who surfaced it become the problem.

● ● ●

Selective Listening

Even when leadership claims they want honest feedback, they only listen to the feedback they like.

Good scores? That's proof we're doing great.

Bad scores? That's people misunderstanding the question.

Positive comments? Share those in the all-hands.

Negative comments? "Oh, that's just one person. It's not representative."

Here's what that sounds like in real life:

The data shows people hate the new process. Leadership: "They just need more training. They'll see the value eventually."

The data shows people don't trust their managers. Leadership: "There is no development training for leaders. We need a better leadership program."

The data shows people feel overworked and burned out. Leadership: "That's just the nature of our industry. Everyone feels that way."

No. Not everyone feels that way. YOUR people feel that way. And dismissing it doesn't make it go away.

● ● ●

Vanity Metrics vs. Reality

Most employee surveys measure the wrong things.

They measure what makes leadership feel good. Not what actually matters.

Vanity metric:

"Overall satisfaction score"

This tells you nothing.

People can be "satisfied" and still be looking for other jobs.

Satisfied doesn't mean engaged. It doesn't mean loyal. It doesn't mean productive.

It means "I don't hate it enough to complain on a survey."

➡️

Reality metric:

"Would you recommend this company to a friend?"

This tells you everything.

Because people don't recommend places they're just "satisfied" with.

They recommend places they actually believe in.

Vanity metric:

"How do you feel about our company values?"

Nobody cares about your values. They care if you actually live them.

Asking how people feel about your values is useless. Ask if leadership demonstrates them. Ask if decisions align with them. That's the data that matters.

➡️

Reality metric:

"Do you see a future for yourself here? or How long are you planning to continue working here?"

This is the retention question.

If people can't see a future, they're already halfway out the door.

And no amount of "satisfied" scores will keep them.

● ● ●

The Cost Of Denial

When companies measure wrong, calculate wrong, and dismiss what they don't like, here's what happens:

Good people leave

Because they told you what was wrong. And you ignored it. So they stop telling you. And they start looking elsewhere.

Problems get worse

Because you're not fixing them. You're pretending they are not relevant enough. And pretending doesn't make them smaller. It makes them bigger.

You lose credibility

Because everyone knows the survey results are BS. They know the real problems. They live them every day.

So when leadership stands up and says "the survey shows we're doing great," nobody believes it.

Next time you ask? They won't bother. Or worse, they'll tell you what you want to hear just to get through it.

And then the witch hunt starts

High-level leaders see bad results and immediately look for someone to blame.

It's the managers' fault. Fire them. Replace them. Fix the scores.

Suddenly, mid-level and front-line managers are terrified. Not of the survey. Of what happens after.

Because they know: bad results mean someone's getting blamed. And it's probably them.

So they start managing the survey instead of managing their teams. They hint at what people should say. They explain why certain scores "wouldn't be fair." They create an environment where people feel pressured to rate things higher than they actually are.

And now your survey isn't measuring reality. It's measuring fear.

The problem isn't the managers. The problem is the system. And you just made it worse by punishing the people who were trying to tell you.

● ● ●

How To Know If Your Survey Is Actually Working

You don't need to be a data scientist. You just need to ask better questions.

Is the survey designed to find problems or avoid them? - If every question is phrased positively, you're fishing for compliments. Not insight.

Are you measuring what matters or what's easy? - Satisfaction is easy. Retention intent is hard. Hard questions give you real data.

Are you willing to act on bad news? - If the answer is no, don't run the survey. You're wasting everyone's time.

Do people trust that their feedback is anonymous? - If they don't, they won't be honest. And your data is worthless.

Can you explain the results without spin? - If you need to "reframe" the data to make it sound good, the data isn't good.

● ● ●

What Good Looks Like (The Basics)

You don't need a perfect survey. You need one that isn't actively lying to you.

Design it right📋

Use a clear and consistent scale. Define what each number means.

Ask one thing per question. No compound questions.

Keep it under 20 questions. Respect people's time.

Run it during a short, consistent time period. Two weeks max, not three months.

Ask only essential demographics. The fewer, the safer people feel.

Calculate it right 🧮

Look at distribution, not just averages.

Segment tenure in meaningful increments (0-3 months, 3-6 months, 6-12 months, 1-2 years, 2-5 years, 5+ years).

Don't exclude new hires. Their feedback matters.

Segment the data. Don't lump everyone together.

Read scores AND comments. Together. Not separately.

Compare apples to apples. Same questions, same scale, same audience.

Present it honestly 📊

Lead with the bad news. Don't bury it.

Show the full picture. Not just the highlights.

Acknowledge what's broken. Don't spin it.

Act on it ☑️

Pick 2-3 real problems. Fix them.

Communicate what you're doing. And why.

Follow up. Show people their feedback mattered.

That's it. You don't need fancy tools. You need honesty.

● ● ●

How To Separate Real Problems From Noise

Not every complaint is a crisis. But not every complaint is noise either.

Here's the test:

Is it specific? - "Morale is low" is vague. "People don't feel heard in meetings" is specific. Specific problems are real problems.

Is it recurring? - One person complaining about parking isn't a trend. Ten people complaining about the same manager is.

Does it impact work? - "The coffee sucks" is annoying. "We don't have the tools to do our jobs" is a crisis.

Can you fix it? - If yes, fix it. If no, acknowledge it and explain why. Don't ignore it just because it's hard.

● ● ●

The Hard Truth

Your employee survey isn't lying to you on purpose.

You're lying to yourself.

You designed a survey that makes you feel good. You calculated the results to look better than they are. You dismissed the feedback you didn't want to hear.

And now you're surprised that people don't trust you.

Here's what actually matters:

Your people know what's broken. They live it every day.

If you're not willing to hear it, don't ask.

But if you ask, and they tell you, and you ignore it?

Don't be shocked when they stop answering your surveys.

And don't be shocked when they stop working for you.

SECTION 2️⃣ - DATA VS. DRAMA

📊 GET YOUR SHIT TOGETHER AND DO THE WORK YOU NEED TO DO

You got bad survey results.

It stings. It feels personal. You're angry. You're defensive. You want to know who said what. You want to explain why they're wrong.

That's drama.

Here's data: your people told you what's broken. Now you fix it.

But first, you have to process it without losing your mind.

Step 1️⃣: Feel it, then close it. | Step 2️⃣: Separate company problems from leadership problems. |

|---|---|

Read the results. Read the comments. Feel whatever you're going to feel - anger, hurt, defensiveness, shock. Then close it. Walk away. Let it breathe. Wait 2-3 days. Then open it again. I promise it won't hurt as much the second time. If it still does, repeat. Third time's the charm. You're not avoiding it. You're giving yourself space to move from drama to data. | Go through the results and split them into two lists: - Issues about the company (tools, policies, resources, structure) - Issues about your leadership directly (communication, trust, support, decisions) This gives you perspective. Some of this you can fix. Some of this you can't. But you need to know which is which. |

Step 3️⃣: Do NOT try to figure out who said what. | Step 4️⃣: Ask for more feedback |

|---|---|

I know you want to. Don't. It's pointless. It's a betrayal of trust. And honestly? Most of this shouldn't be a surprise. If it IS a surprise, that's the real problem. It means your people haven't felt safe enough to tell you this before. That's your work. Not a witch hunt. | You have a list of issues. Now go to your team and ask clarifying questions. "The survey showed concerns about X, Y, and Z. Which of these feels most urgent to you? What would actually help?" They will tell you what matters most. They will give you solutions. You don't have to figure this out alone. Work on a priority matrix with your team. Let them tell you where to start. |

Step 5️⃣: Build your action plan and start working |

|---|

Do NOT wait for HR to tell you what to do. Do NOT wait for someone else to fix it for you. Pick 2-3 things you can actually improve. Make a plan. Communicate it. Start. Then follow up. Show your people their feedback mattered. That's how you move from drama to data. |

● ● ●

If you see survey design problems (broken scales, confusing questions, too many demographics), talk to HR.

Frame it as a data analysis opportunity. Not an attack.

"Hey, I noticed the survey mixes scales and asks compound questions. That's making it hard to act on the feedback. Can we clean this up for next time?"

You're not blaming HR. You're improving the tool so everyone gets better data.

● ● ●

The difference between drama and data:

Drama = "Who said this? Why are they ungrateful? I work so hard for them."

Data = "Okay, here's what's broken. Here's what I can fix. Here's where I start."

One keeps you stuck. The other moves you forward.

Choose data.

See you next Tuesday!

Mariné Rivera P.

ConsultivEX Solutions | www.consultivexs.com

— — — — — — — — — —

Got feedback? Just reply. We read everything. Or fill out the survey.

OUR GUIDELINES

🔥 Our stories are shared by our readers; we just pick the best ones.

✍️ Written by real people, for real people. Always.

📰 We don’t talk politics, religion, or any topics that could potentially offend anyone. Not our core.

🚀 AI assists us, but doesn't drive us.

🌐 We always share our sources so we can shamelessly copy the best practices.

🎯 We don’t force content. If there’s nothing valuable and worth sharing in a section, that section is out that week.